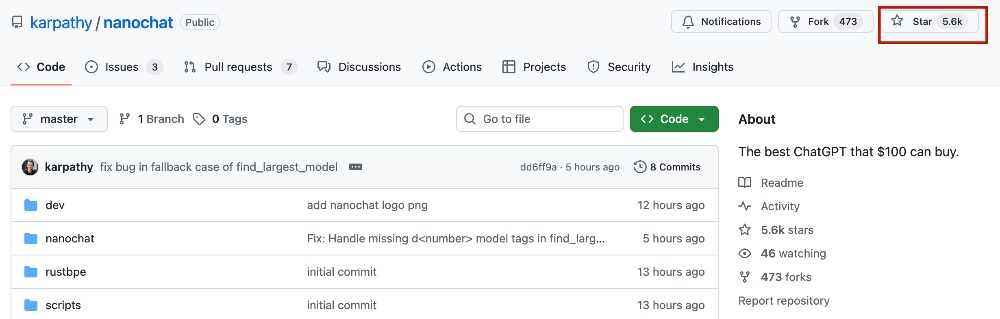

前特斯拉人工智能与自动驾驶视觉总监、OpenAI研究员安德烈·卡帕西(Andrej Karpathy)近日开源项目nanochat,该项目仅需不到100美元(约711元人民币)即可训练出具备基础对话能力的类ChatGPT模型。项目发布后在GitHub上迅速获得大量关注,目前已收获超过5600个星标。

与卡帕西早期仅支持预训练的nanoGPT不同,nanochat是一个完整的全栈训练与推理代码库,依赖极简,实现了从零构建轻量级对话AI的全流程。卡帕西在社交平台上表示,其基础架构参考了Meta的Llama模型并做了简化,同时融合了modded-nanoGPT的部分优化。

据其介绍,完成指令微调阶段的训练耗时约3小时51分钟,成本为92.4美元。若进一步加入强化学习阶段,总训练时间预计在4小时左右,总成本仍可控制在100美元以内。训练所得的模型已具备基础对话、诗歌创作和简单问答能力。

在扩展训练条件下,当投入提升至约1000美元、训练约41.6小时后,模型在多项基准测试中的表现显著提升,尤其在数学推理与编程相关任务中展现出初步能力。例如,在MMLU、ARC-Easy和GSM8K等评测中,模型得分分别超过40分、70分和20分。

nanochat项目代码规模为8304行,具备以下核心功能:

- 基于Rust实现的分词器训练;

- 在FineWeb数据集上预训练Transformer结构语言模型;

- 支持多任务指令微调与强化学习;

- 集成带KV缓存的推理引擎,支持网页交互界面;

- 可生成训练全流程的评估报告。

该项目在社区中引起广泛反响,有开发者已制作出交互式代码图谱以辅助理解其结构。卡帕西也展示了模型生成诗歌的示例,显示出良好的交互能力。目前来看,nanochat以极低成本验证了轻量化训练对话系统的可行性,为AI开发中的资源优化提供了实践参考,尤其有助于推动生成式AI技术在资源受限场景下的应用探索。

(撰写|潇飞)